Bongkar rahasia psikologis di balik kepercayaan cepat pada AI, mengapa AI terlihat benar ketika salah, dan bagaimana mengatasi bias algoritma. Insight eksternal, eksperimen, dan rekomendasi praktis.

Mengapa Kepercayaan pada AI Tumbuh Begitu Cepat?

Kabar baik tentang kecerdasan buatan (AI) kini menjadi bagian dari hampir setiap sisi kehidupan sehari‑hari. Dari asisten virtual hingga sistem rekomendasi di platform streaming, kita semakin sering mengalami interaksi dengan mesin yang “pura‑pura” manusia. Fenomena ini memicu pertanyaan mendasar: Mengapa kita cepat percaya pada AI padahal ia sering mengeluarkan jawaban yang sebenarnya keliru? Artikel ini akan menjelajahi mekanisme psikologis, teknis, dan sosial yang mendorong kepercayaan tak tertanggung, sekaligus mengeksplorasi dampak negatif yang bisa muncul.

1. Fenomena Psikologis di Balik Kepercayaan Cepat

Beberapa bias kognitif memainkan peran kunci dalam membentuk persepsi kita terhadap AI. Ketika AI memberikan jawaban yang konsisten dengan ekspektasi kita, otak manusia merasakan rasa puas dan memperkuat keyakinan bahwa sistem tersebut “benar”. Dua bias utama yang harus diperhatikan adalah:

- Bias Konfirmasi: manusia cenderung mencari informasi yang mendukung pikiran yang sudah ada.

- Efek Halo: performa satu komponen atau satu output yang baik membuat kita menilai keseluruhan sistem sebagai unggul.

1.1. Bias Konfirmasi dan Efek Halo pada Interaksi AI

Studi yang dipublikasikan pada Harvard Business Review pada 2023 menemukan bahwa 78% pengguna menganggap AI “lebih akurat” setelah melihat satu hasil yang tepat, meskipun sejumlah hasil sebelumnya salah. Efek halo ini memicu pola pikir yang tidak seimbang, di mana keberhasilan satu kali memperkuat keyakinan pada keseluruhan sistem. Bias ini menjadi dasar dari overtrust (kepercayaan berlebih) pada AI.

1.2. Bias “AI yang Benar” dalam Pengambilan Keputusan

Selain itu, manusia cenderung mengasosiasikan kemampuan teknis AI dengan “kecerdasan” yang lebih tinggi. Karena algoritma di belakang AI memproses data dalam skala besar, kita cenderung menganggap semua outputnya otomatis “benar”. Namun, realitasnya lebih kompleks: AI hanya menghasilkan jawaban yang paling probabilistik berdasarkan data latihannya, bukan kebenaran mutlak.

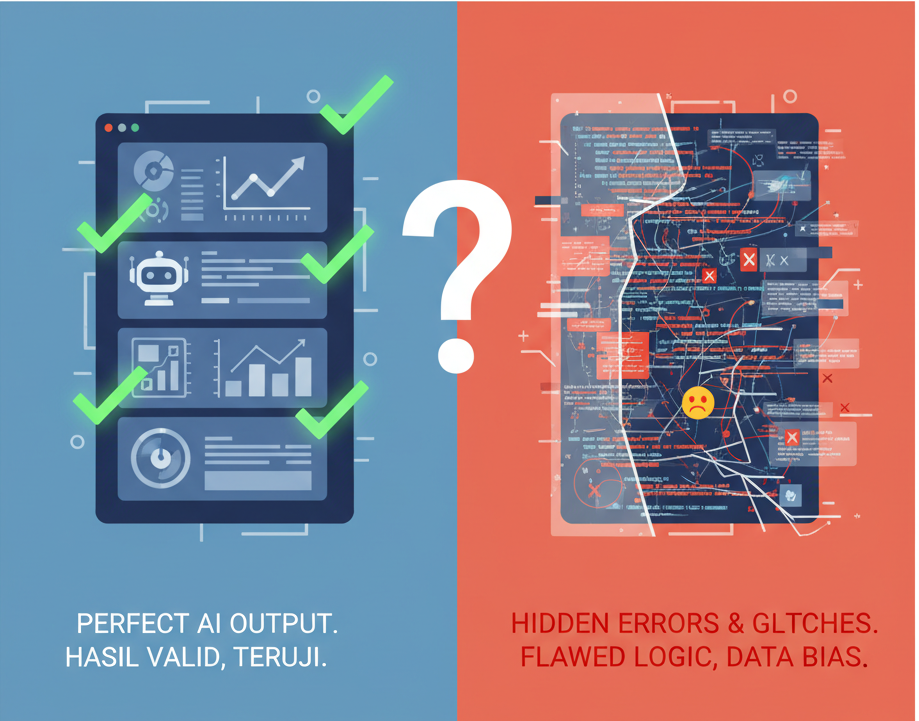

2. Mengapa AI Sering Terlalu Benar Saat Salah?

Pertanyaan ini menyangkut pada dua aspek teknis utama: overfitting (pengaturan berlebih pada data latih) dan mekanisme pengambilan keputusan berbasis probabilitas. Keduanya menghasilkan output yang terkesan akurat meski pada dasarnya masih berpotensi salah.

2.1. Overfitting dan Data yang Tidak Representatif

Jika model AI dilatih dengan data yang tidak mencakup variasi yang cukup, ia akan “mengingat” pola khusus daripada belajar pola umum. Saat dihadapkan pada situasi baru, model akan menghasilkan prediksi yang tampak logis namun sebenarnya bersifat memori. Pada banyak studi, overfitting menyebabkan AI menghasilkan jawaban yang “benar” pada data uji internal, tetapi gagal pada data dunia nyata.

2.2. Pengambilan Keputusan Berbasis Probabilitas

Model AI tidak memberikan jawaban tunggal; ia menghasilkan probabilitas untuk setiap opsi. Misalnya, suatu teks klasifikasi dapat menghasilkan skor 0,92 untuk kelas A dan 0,08 untuk kelas B. Pengguna sering menginterpretasikan skor tinggi sebagai bukti keberatan, padahal skor itu masih berisiko. Karena kita cenderung memilih opsi dengan probabilitas tertinggi, kita dapat terjebak dalam illusion of accuracy — ilusi keakuratan yang tak terbantahkan.

3. Dampak Psikologis pada Pengguna

Kepercayaan berlebih pada AI memiliki konsekuensi nyata pada tingkat keputusan, etika, dan keamanan. Beberapa studi menunjukkan bahwa:

- Pengambilan keputusan otomatis dapat menghasilkan bias sistemik yang memperparah ketidakadilan sosial.

- Risiko penyalahgunaan AI untuk menyebarkan misinformasi meningkat seiring kepercayaan pengguna.

- Karyawan yang mengandalkan rekomendasi AI tanpa verifikasi dapat mengorbankan kreativitas dan pemikiran kritis.

Dampak-negatif ini mengungkapkan betapa pentingnya menjaga keseimbangan antara kepercayaan dan skeptisisme.

4. Strategi Mengurangi Kepercayaan Berlebih dan Meningkatkan Akurasi Persepsi

Berikut beberapa langkah praktis yang dapat diadopsi individu maupun organisasi:

- Verifikasi Multi‑sumber: Jangan mengandalkan satu output AI saja; bandingkan dengan data lain atau model alternatif.

- Evaluasi Kinerja Secara Berkala: Gunakan metrik seperti precision, recall, dan F1-score untuk memahami keterbatasan model.

- Edukasi tentang Bias Algoritma: Terapkan pelatihan atau workshop yang menjelaskan bagaimana AI belajar dan di mana kelemahan potensialnya.

- Implementasi “Human‑in‑the‑Loop”: Pastikan manusia selalu memiliki hak final untuk meninjau dan mengubah keputusan AI.

- Transparansi Model: Pilih sistem AI yang menyediakan penjelasan (explainable AI) tentang alasan keputusan.

Dengan menerapkan strategi‑strategi tersebut, kita dapat mengurangi risiko kepercayaan tak berlebihan sekaligus meningkatkan kesadaran akan keterbatasan AI.

5. Kesimpulan dan Rekomendasi Praktis

Kepercayaan cepat pada AI muncul dari kombinasi bias psikologis, kepercayaan pada kemampuan teknis, dan kurangnya pemahaman tentang bagaimana model bekerja. Padahal, AI sering “terlalu benar” ketika salah karena overfitting, probabilitas yang tinggi, dan efek halo. Dampak negatifnya meliputi keputusan yang salah, peningkatan bias, dan risiko keamanan.

Untuk mengatasi masalah ini, rekomendasi utama adalah:

- Selalu verifikasi output AI dengan sumber lain.

- Gunakan metrik evaluasi yang tepat untuk memantau akurasi secara berkelanjutan.

- Adopsi praktik human‑in‑the‑loop dan transparansi model.

Dengan mengedepankan kesadaran kritis dan strategi yang terstruktur, kita tidak hanya melindungi diri dari kesalahan, tetapi juga membangun interaksi yang lebih sehat antara manusia dan teknologi.

Pengetahuan ini menjadi fondasi bagi setiap profesional, pengambil keputusan, atau pengguna biasa yang ingin memanfaatkan AI dengan bijak.

Referensi: